Branko Devic / Shutterstock.com

Branko Devic / Shutterstock.com

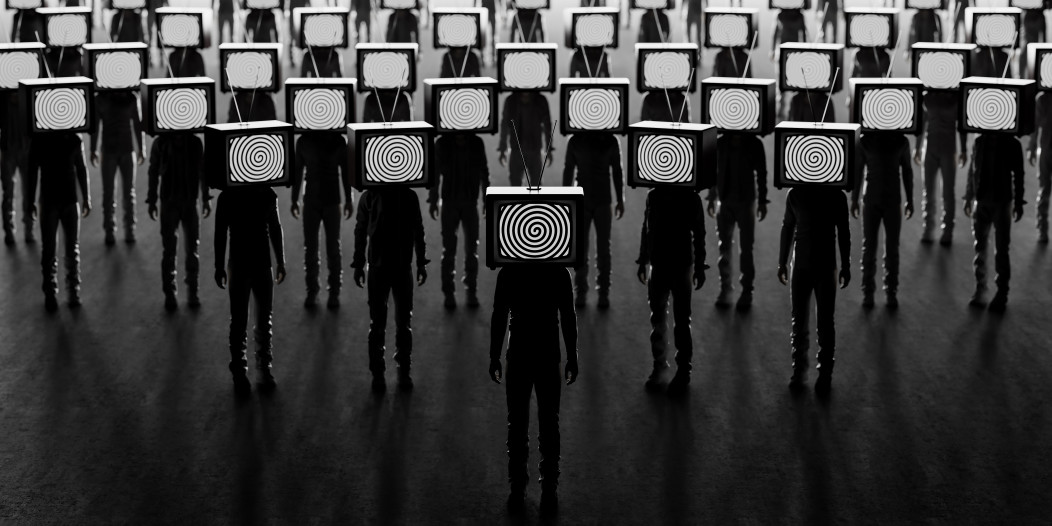

生成AIとプロパガンダ

―― 高度な偽情報にどう対処するか

The Coming Age of AI-Powered Propaganda: How to Defend Against Supercharged Disinformation

2023年5月号掲載論文

チャットGPTなどの対話型AIは、人間が書いた文章かAIによるものかが分からず、大量生産が可能なコンテンツを安価に生成する能力をもっているために。プロパガンダに悪用される恐れがある。実際、AI生成プロパガンダでオンライン空間を埋め尽くせば、疑念の種をまき、真実を見極めるのを難しくし、人々は自分の観察さえ信用できなくなる。社会と共有する現実への信頼を失う危険もある。「こうした言語モデルのアクセスを誰が管理するのか、誰を危険にさらすことになるのか、AIに人間の会話を模倣させるのは望ましいのか」。政府、企業、市民社会そして市民は、こうしたモデルの設計や使用法、そしてそれがもたらす潜在的なリスクを管理する方法について、発言権をもつべきだ。

- チャットGPTの衝撃

- AI言語モデルで何ができるか

- プロパガンダ作戦

- 破壊される信頼

- 対策はあるのか

この論文はSubscribers’ Onlyです。

フォーリン・アフェアーズリポート定期購読会員の方のみご覧いただけます。

会員の方は上記からログインしてください。 まだ会員でない方および購読期間が切れて3ヶ月以上経った方はこちらから購読をお申込みください。会員の方で購読期間が切れている方はこちらからご更新をお願いいたします。

なお、Subscribers' Onlyの論文は、クレジットカード決済後にご覧いただけます。リアルタイムでパスワードが発行されますので、論文データベースを直ちに閲覧いただけます。また、同一のアカウントで同時に複数の端末で閲覧することはできません。別の端末からログインがあった場合は、先にログインしていた端末では自動的にログアウトされます。

(C) Copyright 2023 by the Council on Foreign Relations, Inc., and Foreign Affairs, Japan